Роботы не менее опасны, чем атомная бомба — ученые

Профессор кафедры «Робототехнические системы и мехатроника» МГТУ им. Н.Э. Баумана Аркадий Ющенко выступил на лекции, состоявшейся в рамках лектория стратегического общественного движения «Россия 2045», и заявил: роботы не менее опасны, чем атомная бомба. Тезисы выступления ученого записала Lenta.ru.

Проблема диалога человека с роботом возникла не сразу, хотя она и рассматривалась с самого начала робототехники. С момента основания  эта наука прошла три стадии эволюции. В 60-70-х годах разрабатывались жестко запрограммированные машины, которых мы сейчас уже роботами и не называем — по сути, они мало чем отличались от станка с программным управлением. Практически одновременно с ними появилось другое направление — копирующие системы, представляющие собой устройства взаимодействия машины с человеком, в том числе и для замены его в опасных условиях.

эта наука прошла три стадии эволюции. В 60-70-х годах разрабатывались жестко запрограммированные машины, которых мы сейчас уже роботами и не называем — по сути, они мало чем отличались от станка с программным управлением. Практически одновременно с ними появилось другое направление — копирующие системы, представляющие собой устройства взаимодействия машины с человеком, в том числе и для замены его в опасных условиях.

Следующей стадией развития этих машин следует считать появление компьютерного зрения, датчиков силы, осязания. Роботы, как мы говорим, стали «очувствленными». Машины второго направления, управляющиеся непосредственно человеком, тоже стали приобретать некоторую самостоятельность. В результате сейчас из первого направления выросло почти безлюдное производство, а второе породило интеллектуальных роботов, управляемых речью, способных на диалог с человеком.

Благодаря речевому управлению роботом второго типа можно управлять без джойстика, рычагов или пульта, ему нужно просто подавать голосовые команды. Здесь появляется система, которую можно назвать диалоговой, когда помимо обратной связи через зрение, слух и осязание добавляется обратная связь с машиной через речь. Робот в таком случае может формировать речевые сообщения на том же языке, на котором говорит оператор (правда, этот язык весьма ограничен и профессионально ориентирован). Эта система эргатическая (человеко-машинная), и ее невозможно спроектировать, не учитывая особенностей не только машины, но и человека.

Области применения роботов

Если говорить об области применения человеко-машинных робототехнических интеллектуальных систем, то они используются уже в наше время. Экстремальная робототехника эксплуатируется в рамках борьбы с террористами или управления роботами в космосе. Робототехнические аппараты также способны осуществлять охрану помещений и территорий.

Совершенно неожиданно начала бурно развиваться сервисная робототехника. Я смотрел экономические показатели, сколько тратится средств на специальную и на сервисную робототехнику, и

Благодаря системам с «очувствленным» интерфейсом, человек может ощущать на расстоянии силу, которую развивает роботизированный манипулятор в той среде, где он функционирует. Помимо этого, он может использовать стереозрение, и таким образом, создается эффект телеприсутствия.

Телеуправление активно используется в космосе. Оператор при этом может находиться как в кабине космического корабля, так и где-нибудь еще. Например, «Шаттл» управляется с помощью двух джойстиков с тремя степенями свободы для перемещения и ориентации. Увы, если этой системой управлять с Земли, то возникает задержка, делающая телеуправление невозможным. Если же так управлять системой, находящейся на Луне, то задержка составит несколько минут, оператор не сможет адекватно воспринимать прилагаемые усилия и начнутся проблемы. Тут нужны роботы, управляющиеся не непосредственно человеком, а заложенной в них программой и обладающие определенной автономностью.

В России уже работают медицинские робототехнические комплексы «Да Винчи». Они требуют определенных навыков от хирурга, который вообще может находиться в другой комнате. Некоторые операции выполняются автоматически, например зашивание швов, некоторые — под контролем оператора.

При использовании таких роботов в принципе может быть применено удаленное управление. Наши коллеги из Корейского технологического университета проводили такую операцию, когда больной находился в Сиэтле, а хирург — в Корее. Не думаю, что это будет широко использоваться, но в глубинке, где нет хирургического центра, эта технология вполне может пригодиться.

Уже существуют экзоскелеты с управлением от биотоков мышц, например корейский HAL-5. Он надевается на человека, в его суставах находятся приводы, датчики давления, оказываемого на пол. Но самое интересное здесь другое — он оборудован сенсором биоэлектрических сигналов. Поэтому его может использовать частично парализованный человек: биотоки можно считывать, и экзоскелет будет помогать ему двигаться. Постепенно у пациента начинается восстановление собственных моторных функций, он начинает сам ходить, двигать руками. Этому направлению сейчас уделяется много внимания, ведь экзоскелеты могут быть применены и для здоровых людей: для выполнения каких-либо операций, требующих приложения значительных физических усилий.

«Сотрудничество» робота и человека

Термин «кооперативное управление» появился в 2001 году на очередной конференции по робототехнике. Он описывает взаимодействие  человека и робота, которое может происходить на самых разных уровнях.

человека и робота, которое может происходить на самых разных уровнях.

Когда робот становится ассистентом оператора, с которым можно разговаривать, давать ему какую-то задачу? Когда у него есть хорошая база знаний, когда он умеет правильно интерпретировать цель оператора путем диалога, когда он умеет планировать операции, формировать команды управления. Получая и суммируя информацию со своих сенсоров, он должен давать обобщенную оценку происходящего, в том числе и для оператора. За человеком же остается определение цели, диалог с роботом о том, что нужно сделать. Непосредственное управление джойстиками и прочими подобными устройствами тут вовсе не обязательно.

Описание внешнего мира и ситуации должно происходить таким образом, чтобы человек и робот могли понимать друг друга, они должны использовать одинаковые термины. Очевидно, что когда мы смотрим на определенный объект, то не можем точно определить расстояние до него в метрах и сантиметрах, мы просто говорим, что он находится далеко или близко. Эти термины приводят нас к так называемой «нечеткой логике» и «лингвистическим переменным», которые позволяют эффективно решать задачу диалога машины и человека. В ряд этих проблем входит необходимость автоматического планирования действий, создание проблемно-ориентированного языка, а также проблема обучения робота.

В общем, язык робота должен быть похож на естественный, база знаний также должна быть сходной со знаниями человека. Все это — антропоморфность, касающаяся не только движений и внешнего вида аппарата, но и интеллектуального уровня взаимодействия.

Чем проще работать человеку, тем сложнее должна быть устроена система управления роботом. Он должен адаптироваться к условиям среды, планировать свои действия. Грань между тем, что известно заранее и что должен робот определить сам, все время сдвигается наверх, роботы становятся все более интеллектуальными.

Антропоморфность и картина мира

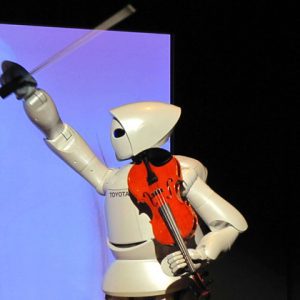

Антропоморфность в своем наиболее простом представлении заключается в том, что машина должна внешне быть похожей на человека. Почему? Скажем, двумя руками проще манипулировать объектом. При этом одна рука будет держать предмет, а вторая — выполнять операции, связанные с ним.

Поэтому появились двурукие промышленные роботы. Одни занимаются тем, что поднимают и переставляют ящики, другие дезактивируют гранаты, одной рукой держа ее, а другой — откручивая взрыватель. Робот может быть оборудован и тремя руками, но особой необходимости в этом нет. Кстати, вот еще одна причина антропоморфности: если мы хотим, чтобы машина нас заменила, она должна быть похожа на человека, так как все оборудование рассчитано на то, что им будет управлять человек, хотя мы часто об этом не задумываемся.

Первая задача на пути к диалогу робота и человека — это построение модели внешнего мира. Как говорил доктор технических наук Дмитрий Поспелов, «модель внешнего мира целесообразно строить с использованием естественных отношений пространства и времени». Что это значит? Такие понятия, как «близко — далеко», «справа — слева», «немного впереди и направо», «быстрее», касаются и температуры, и влажности, и вообще всего, чего угодно, именно так, как это воспринимает человек. Модель внешнего мира должна быть построена на основе нечетких психолингвистических шкал. Это действительно шкалы — если вы, скажем, задаете с помощью них расстояние, то можете задать его градацию.

Также существуют некоторые отношения, которые нельзя описать с помощью функций принадлежности, такие как «объект имеет горизонтальное или вертикальное положение». Применяя их, можно формировать полное описание ситуации — «объект стоит на чем-то далеко справа, от другого объекта отстоит на определенное расстояние». Получается то, что мы называем семиотической формой описания, когда всему можно придать определенные символы.

Здесь я под свою ответственность ввожу такое определение: «ситуация является эргатически наблюдаемой (то есть наблюдаемой человеком), если оператор может по лингвистической информации, дополненной показаниями информационно-сенсорной системы, составить адекватное представление о текущей ситуации». Иначе говоря, она соответствует его восприятию, он может ее достроить. Видя только ее описание, он может представить, что происходит. Таким образом, можно составить план, и машина будет помогать выстраивать ситуацию и принимать решения.

Может вводиться комментарий, облегчающий восприятие сцены оператором. Более того, робот может самостоятельно проводить идентификацию объекта и выдавать для человека нечто подобное: «мне кажется, что это стол» или «мне кажется, что это фонарь». Это облегчает процесс принятия решений.

Управление и «эмоции»

Если подходить к проблеме шире, то окажется, что существует несколько уровней управления. То, о чем говорилось ранее, — это исполнительный уровень, но есть и другие. Например, в случае с роботом-пожарным на стратегическом уровне планирования находятся люди, определяющие тип пожара и то, что нужно делать, на тактическом уровне решения принимает оператор, находящийся в зоне пожара и непосредственно руководящий действиями робота. Наконец, сам робот наблюдает за тем, что происходит и передает информацию оператору.

На исполнительном уровне это обычная система с обратной связью. Она принимает правильные решения, заложенные в базе, и робот едет. Это хорошо тем, что правила для этого робота пишет сам человек. Самый лучший пример — токийское метро, где некоторые поезда ходят без водителя. Здесь очень удобно применять нечеткие правила (ведь поезд едет в одну сторону), которые довольно легко формализовать: когда тормозить или скорость сбрасывать, причем не математически, а именно в тех терминах, которые использует машинист. Таким же образом можно управлять чем угодно — например, выполнять парковку задним ходом. Математически эту задачу не решить никогда, но если вы водите автомобиль, то легко сможете определить правила парковки и заложить их в базу знаний робота.

Движения, которым робот может заранее научиться, — пройти в ворота, обойти препятствия — я называю рефлексивными. Из них можно формировать довольно сложные действия уже в процессе передвижения машины — например, проехать через лес, если расположение объектов в нем заранее известно, и достичь заданной цели.

Для выполнения операции может не хватать информации. Например, я сказал роботу, куда нужно положить предмет, но не сказал, можно ли это сделать, какая эта поверхность — может быть, она наклонная. Машина должна получить дополнительную информацию, она может объехать, посмотреть на предмет, взять его, пощупать. То есть она может выполнять и когнитивные операции, автоматически планируя их, если они необходимы для выполнения поставленной задачи.

Бывают ситуации, когда мы не можем знать, с чем столкнется робот. Александр Жданов из Института системных исследований разработал направление, в которое ввел так называемый «аппарат эмоций». Название это, конечно, очень условно — этот аппарат просто обеспечивает оценку действий робота. Если эти действия были правильными, то они поддерживаются, а если они были неправильными, то, грубо говоря, машина получает какой-то штраф. Робота можно запустить в комнату и дать ему столкнуться с несколькими стульями так, чтобы он смог пройти между ними до конечной точки. Сделает это он не сразу, а за несколько проходов, обучаясь. Все это нужно для работы робота в непредсказуемых условиях.

Если говорить о выражении «эмоций» роботом, то, например, наши выпускники продемонстрировали на недавней выставке в «Сколково» серию сервисных роботов, которые могут выполнять функцию гидов. На их экране может отображаться лицо, с которым человек как бы общается, а реплики робота подкрепляются мимикой — так человек лучше воспринимает то, что ему говорят, ведь одна и та же фраза, произнесенная с разным выражением лица, будет понята по-разному. С помощью мимики робот может выражать свое отношение к ситуации, собственному состоянию (скажем «у меня перегорела какая-либо деталь») и даже к партнеру. Сейчас также активно развивается направление по управлению роботами с помощью жестов, дополняющих речь.

Задачи на будущее

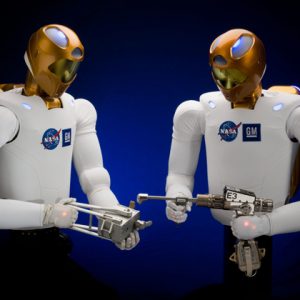

Самая важная задача, стоящая перед робототехникой в будущем, — это обеспечение управления коллективами роботов. Коллектив машин способен выполнять качественно иные задачи, чем один робот.

Мне кажется, что общество возникло тогда, когда появилось речевое общение между отдельными субъектами. И, знаете, роботы начали общаться. Они переговариваются — для них делают специальные языки. Я допускаю, что когда-нибудь они будут обсуждать меня, говоря друг другу, что, мол, этот оператор сегодня не в форме, давайте не будем слушать его команды и сделаем что-нибудь самостоятельно.

После этого возникает уже задача взаимодействия коллективов людей и роботов. Не успеем мы оглянуться, как роботы будут включены в наше общество. В связи с этим возникают проблемы этического, юридического и социально-психологического характера.

Поэтому сейчас уже разрабатываются положения, выросшие из первого закона Азимова, который гласит, что робот не должен причинять вред оператору своим действием или бездействием. Второй же закон гласит, что робот не должен причинять вред и себе, если это не противоречит первому закону. Но как быть с военными роботами, которые убивают людей, таким образом нарушая первый закон? Здесь нужно провести какую-то грань, ведь приняли же мы законы, запрещающие применение ядерного оружия. Без соответствующих международных договоренностей роботы могут стать не менее опасными, чем атомная бомба.

050013, Республика Казахстан г. Алматы, мкр. Керемет, дом 7, корпус 39, оф. 472