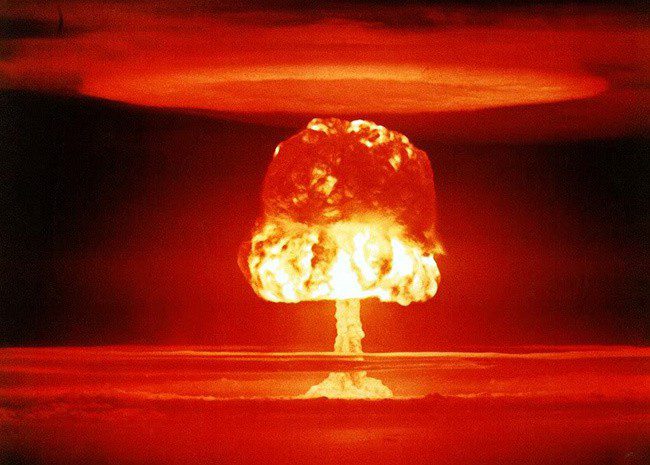

Как роботы могут развязать ядерную войну, рассказал генерал из США

Искусственный интеллект нельзя допускать к управлению ядерным оружием из-за возможности роковой ошибки.

Такого мнения придерживается бывший заместитель министра обороны США, генерал Роберт Уорк, передает «Лайф» со ссылкой на Breaking Defense. По мнению военного, системы искусственного интеллекта должны быть отдалены от контроля над ядерным вооружением и принятия решений о запуске. Уорк убежден, что машина может ошибиться и расценить второстепенные факты как важные, что является «тревожной перспективой».

В пример он приводит российскую систему «Периметр», которая, по предположению Уорка, может принять сейсмическую активность за ядерные взрывы. В этом случае, как полагает генерал, она отправит запрос в штаб войск. Если запрос останется без ответа, система может самостоятельно произвести пуск ракет.

— Представьте: система искусственного интеллекта в командном центре войск КНР анализирует оперативные данные, заявляет, что США готовятся нанести удар по Китаю, и рекомендует нанести превентивный удар, — продолжает Уорк.

В то же время он отмечает, что использование ИИ приносит и пользу современной армии, позволяя, например, артиллерии производить более точные выстрелы, снижая потенциальные потери среди мирного населения и союзных военных. Однако допускать искусственный интеллект к ядерному вооружению не стоит, поскольку это может привести к «катастрофическому сценарию».

050013, Республика Казахстан г. Алматы, мкр. Керемет, дом 7, корпус 39, оф. 472